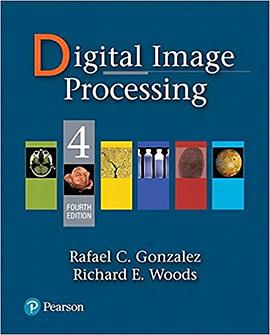

Digital Image Processing (4th Edition) pdf epub mobi txt 电子书 下载 2026

- 图像处理

- Image

- 计算机

- 数字图像处理

- 计算机科学

- Process

- 机器学习

- 数字信号处理

- 图像处理

- 数字图像处理

- 图像分析

- 计算机视觉

- 图像算法

- 图像增强

- 图像复原

- 图像分割

- 图像特征提取

- DIP

具体描述

作者简介

Rafael C. Gonzalez received the B.S.E.E. degree from the University of Miami in 1965 and the M.E. and Ph.D. degrees in electrical engineering from the University of Florida, Gainesville, in 1967 and 1970, respectively. He joined the Electrical and Computer Engineering Department at University of Tennessee, Knoxville (UTK) in 1970, where he became Associate Professor in 1973, Professor in 1978, and Distinguished Service Professor in 1984. He served as Chairman of the department from 1994 through 1997. He is currently a Professor Emeritus at UTK.

Gonzalez is the founder of the Image & Pattern Analysis Laboratory and the Robotics & Computer Vision Laboratory at the University of Tennessee. He also founded Perceptics Corporation in 1982 and was its president until 1992. The last three years of this period were spent under a full-time employment contract with Westinghouse Corporation, who acquired the company in 1989.

Under his direction, Perceptics became highly successful in image processing, computer vision, and laser disk storage technology. In its initial ten years, Perceptics introduced a series of innovative products, including: The world's first commercially-available computer vision system for automatically reading the license plate on moving vehicles; a series of large-scale image processing and archiving systems used by the U.S. Navy at six different manufacturing sites throughout the country to inspect the rocket motors of missiles in the Trident II Submarine Program; the market leading family of imaging boards for advanced Macintosh computers; and a line of trillion-byte laserdisc products.

He is a frequent consultant to industry and government in the areas of pattern recognition, image processing, and machine learning. His academic honors for work in these fields include the 1977 UTK College of Engineering Faculty Achievement Award; the 1978 UTK Chancellor's Research Scholar Award; the 1980 Magnavox Engineering Professor Award; and the 1980 M.E. Brooks Distinguished Professor Award. In 1981 he became an IBM Professor at the University of Tennessee and in 1984 he was named a Distinguished Service Professor there. He was awarded a Distinguished Alumnus Award by the University of Miami in 1985, the Phi Kappa Phi Scholar Award in 1986, and the University of Tennessee's Nathan W. Dougherty Award for Excellence in Engineering in 1992.

Honors for industrial accomplishment include the 1987 IEEE Outstanding Engineer Award for Commercial Development in Tennessee; the 1988 Albert Rose Nat'l Award for Excellence in Commercial Image Processing; the 1989 B. Otto Wheeley Award for Excellence in Technology Transfer; the 1989 Coopers and Lybrand Entrepreneur of the Year Award; the 1992 IEEE Region 3 Outstanding Engineer Award; and the 1993 Automated Imaging Association National Award for Technology Development.

Gonzalez is author or co-author of over 100 technical articles, two edited books, and four textbooks in the fields of pattern recognition, image processing and robotics. His books are used in over 500 universities and research institutions throughout the world. He is listed in the prestigious Marquis Who's Who in America, Marquis Who's Who in Engineering, Marquis Who's Who in the World, and in 10 other national and international biographical citations. He ii is the co-holder of two U.S. Patents, and has been an associate editor of the IEEE Transactions on Systems, Man and Cybernetics, and the International Journal of Computer and Information Sciences. He is a member of numerous professional and honorary societies, including Tau Beta Pi, Phi Kappa Phi, Eta Kapp Nu, and Sigma Xi. He is a Fellow of the IEEE.

Richard E. Woods earned his B.S., M.S., and Ph.D. degrees in Electrical Engineering from the University of Tennessee, Knoxville in 1975, 1977, and 1980, respectively. He became an Assistant Professor of Electrical Engineering and Computer Science in 1981 and was recognized as a Distinguished Engineering Alumnus in 1986.

A veteran hardware and software developer, Dr. Woods has been involved in the founding of several high-technology startups, including Perceptics Corporation, where he was responsible for the development of the company’s quantitative image analysis and autonomous decision-making products; MedData Interactive, a high technology company specializing in the development of handheld computer systems for medical applications; and Interapptics, an internet-based company that designs desktop and handheld computer applications.

Dr. Woods currently serves on several nonprofit educational and media-related boards, including Johnson University, and was recently a summer English instructor at the Beijing Institute of Technology. He is the holder of a U.S. Patent in the area of digital image processing and has published two textbooks, as well as numerous articles related to digital signal processing. Dr. Woods is a member of several professional societies, including Tau Beta Pi, Phi Kappa Phi, and the IEEE.

目录信息

读后感

本科计算机专业,研究生做图像处理模式识别方面,所以看了这本书,可能是基础原因,本科没有学过信号处理,看起来很吃力,要补一下基础了,另外,中文版千万别看,错误太多,误导人,比如中文版第三版第150页,“因为DFT和IDFT中的所有指数都是正的”,其中这个指数让我狂抓,...

评分1、最好在看这本书之前复习一下线性代数和概率论,里面有很多的公式,否则很痛苦。 2、老外写的书嘛,很细致,内容很丰富,很容易懂。 3、最好有一定的英文水平,里面的专业名词实在是太多了,我现在看得相当纠结,手边必备一本词典。 4、图片相当精致(如果买的是正版的话),...

评分理论略显枯燥,但配合图片和代码学起来还是有收获的。英语好的可以去看英文原版,用我导师的话说,是图像处理英文论文写作的参考教材!

评分用几个月的时间,大体看了一遍,总体感受是一本好书被翻译成了垃圾 建议大家去读原版 另外,原书又发布了第4版,大家可以去下载,是2018年刚刚新鲜出炉的哟 第4版改动比较大,多了神经网络的内容,建议大家不要再读第3版了 链接:https://pan.baidu.com/s/1uWnysDUVW3dm68e4ZCo...

评分向了解数字图象处理的话,此书是很好的入门, 我一个礼拜看完的, 别看书厚,其实不是很难, 解释比较多(简单的说老外废话比较多) 读完这本书你会对数字图象处理有一个整体的了解, 但是也仅此而已, 细节还是要看专题.

用户评价

说实话,我拿到这本《数字图像处理》的时候,是抱着“拯救我于水火”的期望的。我的背景偏向于软件工程,对信号处理的基础实在是一窍不通。我当时最头疼的就是那些关于噪声模型和滤波器的章节,总觉得那些高斯白噪声、椒盐噪声的数学表达太抽象了。然而,这本书的叙述方式却有一种奇特的魔力,它没有一上来就扔一堆复杂的矩阵让你看晕,而是先用非常直观的例子来描绘噪声对图像的“破坏性”,然后再循序渐进地引入最小均方误差(MMSE)准则,最后才引出维纳滤波的复杂公式。这种“先体验,后理论”的教学方法,极大地降低了我的学习曲线。更别提它对形态学处理的讲解,那些腐蚀、膨胀、开运算、闭运算,它不仅图文并茂地展示了它们在二值图像上的效果,还延伸到了灰度图像的处理,展示了其在边缘检测和特征提取中的强大威力。这本书的排版也相当考究,代码示例(虽然是伪代码风格)清晰易懂,注释充分,非常适合动手实践。读完它,我感觉自己仿佛被重新教育了一遍,对图像的“像素”层面有了前所未有的敬畏感。

评分这本书的深度和广度,绝对是业界标杆。我用过好几本图像处理的参考书,但没有哪一本能像它一样,在保证理论深度的同时,还能覆盖如此广泛的应用领域。举个例子,当你还在为如何用阈值法分割图像焦头烂额时,这本书已经深入探讨了区域生长、分水岭算法,甚至是更先进的基于能量最小化的分割方法。它对彩色图像处理的章节尤其值得称道,不仅仅是RGB色彩空间的转换和量化,它还详细解析了HSI和YUV等其他关键色彩空间的特性及其在不同应用场景下的优势。我记得有一次处理一个涉及到皮肤病变图像的课题,对色彩的敏感度和准确性要求极高,我正是从这本书中找到了关于色彩空间变换稳定性的关键论述,从而避免了色彩失真的陷阱。这本书的价值在于它的前瞻性,它没有停留在上个世纪的经典算法上沾沾自喜,而是将现代图像分析中的核心技术,如小波变换在压缩和去噪中的应用,以及初步的模式识别基础,都融入其中,使得这本书即便在技术飞速迭代的今天,依然保持着极高的参考价值。

评分坦白说,这本书的阅读体验并非一帆风顺,它更像是一场需要投入大量精力的“学术马拉松”。对于那些期待在几个周末内速成图像处理的读者来说,这本书可能会显得过于“沉重”。它的论证过程极其严谨,每一个结论的得出都建立在坚实的数学基础之上,这要求读者必须具备扎实的线性代数和微积分功底。我个人认为,这本书最适合作为研究生级别的教材或资深工程师的案头工具书。我记得我在研究图像去模糊化时,一开始尝试了朴素的逆滤波,效果惨不忍睹。后来翻到这本书关于“盲复原”的章节,才意识到在不知道点扩散函数(PSF)的情况下,迭代约束反卷积(如Lucy-Richardson算法)才是正途。这本书的精妙之处在于,它不仅告诉了你这些方法存在,更深入地探讨了它们各自的局限性、收敛性以及实际操作中可能遇到的数值不稳定性问题。这种对“细节的执着”,是普通教材所不具备的,它教会我的是一种严谨的、不轻易下结论的科研态度。

评分作为一本厚重的参考书,它在知识体系的构建上起到了定海神针的作用。我特别欣赏作者在组织内容时所体现出的清晰脉络——从基础的图像获取与量化,到空间域和频率域的变换,再到图像增强、复原,直至最后的分割和描述。这种由浅入深、层层递进的结构,使得读者可以非常清晰地追踪整个图像处理流程的逻辑链条。我曾经将它与一本侧重于应用和代码实现的教材并用,结果发现,没有这本书提供的坚实理论背景,那些“神奇”的代码实现不过是空中楼阁。例如,在学习边缘检测时,这本书对Sobel、Prewitt算子背后的微分近似原理进行了深入剖析,并对比了拉普拉斯算子和Canny算子的优劣,特别是Canny算法中“滞后阈值”的巧妙之处,被讲解得入木三分。总而言之,这本书提供了一个完整的知识图谱,让你不仅知道“是什么”,更明白了“为什么是这样”,这对于构建一个稳固且可扩展的图像处理知识体系至关重要,它确保了你在面对新问题时,能够从第一原理出发进行创新和解决。

评分这部图像处理圣经般的巨著,厚得能当镇纸用,内容之博大精深令人叹为观止。我得说,这本书不仅仅是一本教科书,它简直就是一本工具箱,里面塞满了从基础理论到尖端应用的各种知识。初次翻开时,那种扑面而来的数学公式和算法推导确实让人有点眩晕,但一旦你沉下心来,跟着作者的逻辑一步步深入,你会发现那些曾经晦涩难懂的概念是如何被清晰地解构和阐述的。尤其让我印象深刻的是它对傅里叶变换在图像域和频率域之间转换的细腻描绘,那种深入骨髓的讲解,让我终于明白了小波变换和Hough变换背后的真正含义,而不是仅仅停留在会用API的层面。对于任何想要在计算机视觉或者医学影像领域深耕的人来说,这本书提供的理论基础是无可替代的。它不是那种只教你怎么“点鼠标”的书,它教你的是“为什么”要这么点,以及如何从零开始构建自己的处理流程。我特别喜欢它在案例分析部分展现出的严谨性,每一个算法的复杂度分析都做到了详尽无遗,这对于优化实际工程中的性能至关重要。这本书的存在,让那些市面上充斥的“快速入门”指南显得像小儿科一样肤浅。

评分classic, clear, comprehensive

评分classic, clear, comprehensive

评分classic, clear, comprehensive

评分classic, clear, comprehensive

评分classic, clear, comprehensive

相关图书

本站所有内容均为互联网搜索引擎提供的公开搜索信息,本站不存储任何数据与内容,任何内容与数据均与本站无关,如有需要请联系相关搜索引擎包括但不限于百度,google,bing,sogou 等

© 2026 onlinetoolsland.com All Rights Reserved. 本本书屋 版权所有