具体描述

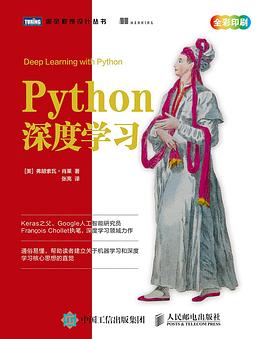

本书由Keras之父、现任Google人工智能研究员的弗朗索瓦•肖莱(François Chollet)执笔,详尽介绍了用Python和Keras进行深度学习的探索实践,涉及计算机视觉、自然语言处理、生成式模型等应用。书中包含30多个代码示例,步骤讲解详细透彻。由于本书立足于人工智能的可达性和大众化,读者无须具备机器学习相关背景知识即可展开阅读。在学习完本书后,读者将具备搭建自己的深度学习环境、建立图像识别模型、生成图像和文字等能力。

作者简介

【作者简介】

弗朗索瓦•肖莱(François Chollet)

Keras之父,TensorFlow机器学习框架贡献者,Kaggle竞赛教练,个人Kaggle竞赛全球排名曾获得第17名。目前任职于Google,从事人工智能研究,尤其关注计算机视觉与机器学习在形式推理方面的应用。

【译者简介】

张亮(hysic)

毕业于北京大学物理学院,爱好机器学习和数据分析的核安全工程师,译有《Python数据处理》《Python机器学习基础教程》等。

目录信息

第1章 什么是深度学习 2

1.1 人工智能、机器学习与深度学习 2

1.1.1 人工智能 3

1.1.2 机器学习 3

1.1.3 从数据中学习表示 4

1.1.4 深度学习之“深度” 6

1.1.5 用三张图理解深度学习的工作原理 7

1.1.6 深度学习已经取得的进展 9

1.1.7 不要相信短期炒作 9

1.1.8 人工智能的未来 10

1.2 深度学习之前:机器学习简史 11

1.2.1 概率建模 11

1.2.2 早期神经网络 11

1.2.3 核方法 12

1.2.4 决策树、随机森林与梯度提升机 13

1.2.5 回到神经网络 14

1.2.6 深度学习有何不同 14

1.2.7 机器学习现状 15

1.3 为什么是深度学习,为什么是现在 15

1.3.1 硬件 16

1.3.2 数据 17

1.3.3 算法 17

1.3.4 新的投资热潮 17

1.3.5 深度学习的大众化 18

1.3.6 这种趋势会持续吗 18

第2章 神经网络的数学基础 20

2.1 初识神经网络 20

2.2 神经网络的数据表示 23

2.2.1 标量(0D张量) 23

2.2.2 向量(1D张量) 24

2.2.3 矩阵(2D张量) 24

2.2.4 3D张量与更高维张量 24

2.2.5 关键属性 25

2.2.6 在Numpy中操作张量 26

2.2.7 数据批量的概念 27

2.2.8 现实世界中的数据张量 27

2.2.9 向量数据 27

2.2.10 时间序列数据或序列数据 28

2.2.11 图像数据 28

2.2.12 视频数据 29

2.3 神经网络的“齿轮”:张量运算 29

2.3.1 逐元素运算 30

2.3.2 广播 31

2.3.3 张量点积 32

2.3.4 张量变形 34

2.3.5 张量运算的几何解释 34

2.3.6 深度学习的几何解释 35

2.4 神经网络的“引擎”:基于梯度的优化 36

2.4.1 什么是导数 37

2.4.2 张量运算的导数:梯度 38

2.4.3 随机梯度下降 38

2.4.4 链式求导:反向传播算法 41

2.5 回顾第一个例子 41

本章小结 42

第3章 神经网络入门 43

3.1 神经网络剖析 43

3.1.1 层:深度学习的基础组件 44

3.1.2 模型:层构成的网络 45

3.1.3 损失函数与优化器:配置学习过程的关键 45

3.2 Keras简介 46

3.2.1 Keras、TensorFlow、Theano 和CNTK 47

3.2.2 使用Keras 开发:概述 48

3.3 建立深度学习工作站 49

3.3.1 Jupyter笔记本:运行深度学习实验的首选方法 49

3.3.2 运行Keras:两种选择 50

3.3.3 在云端运行深度学习任务:优点和缺点 50

3.3.4 深度学习的最佳GPU 50

3.4 电影评论分类:二分类问题 51

3.4.1 IMDB 数据集 51

3.4.2 准备数据 52

3.4.3 构建网络 52

3.4.4 验证你的方法 56

3.4.5 使用训练好的网络在新数据上生成预测结果 59

3.4.6 进一步的实验 59

3.4.7 小结 59

3.5 新闻分类:多分类问题 59

3.5.1 路透社数据集 60

3.5.2 准备数据 61

3.5.3 构建网络 61

3.5.4 验证你的方法 62

3.5.5 在新数据上生成预测结果 65

3.5.6 处理标签和损失的另一种方法 65

3.5.7 中间层维度足够大的重要性 65

3.5.8 进一步的实验 66

3.5.9 小结 66

3.6 预测房价:回归问题 66

3.6.1 波士顿房价数据集 67

3.6.2 准备数据 67

3.6.3 构建网络 68

3.6.4 利用K折验证来验证你的方法 68

3.6.5 小结 72

本章小结 73

第4章 机器学习基础 74

4.1 机器学习的四个分支 74

4.1.1 监督学习 74

4.1.2 无监督学习 75

4.1.3 自监督学习 75

4.1.4 强化学习 75

4.2 评估机器学习模型 76

4.2.1 训练集、验证集和测试集 77

4.2.2 评估模型的注意事项 80

4.3 数据预处理、特征工程和特征学习 80

4.3.1 神经网络的数据预处理 80

4.3.2 特征工程 81

4.4 过拟合与欠拟合 83

4.4.1 减小网络大小 83

4.4.2 添加权重正则化 85

4.4.3 添加dropout正则化 87

4.5 机器学习的通用工作流程 89

4.5.1 定义问题,收集数据集 89

4.5.2 选择衡量成功的指标 89

4.5.3 确定评估方法 90

4.5.4 准备数据 90

4.5.5 开发比基准更好的模型 90

4.5.6 扩大模型规模:开发过拟合的模型 91

4.5.7 模型正则化与调节超参数 92

本章小结 92

第二部分 深度学习实践

第5章 深度学习用于计算机视觉 94

5.1 卷积神经网络简介 94

5.1.1 卷积运算 96

5.1.2 最大池化运算 101

5.2 在小型数据集上从头开始训练一个卷积神经网络 102

5.2.1 深度学习与小数据问题的相关性 103

5.2.2 下载数据 103

5.2.3 构建网络 106

5.2.4 数据预处理 107

5.2.5 使用数据增强 111

5.3 使用预训练的卷积神经网络 115

5.3.1 特征提取 116

5.3.2 微调模型 124

5.3.3 小结 130

5.4 卷积神经网络的可视化 130

5.4.1 可视化中间激活 131

5.4.2 可视化卷积神经网络的过滤器 136

5.4.3 可视化类激活的热力图 142

本章小结 146

第6章 深度学习用于文本和序列 147

6.1 处理文本数据 147

6.1.1 单词和字符的one-hot编码 149

6.1.2 使用词嵌入 151

6.1.3 整合在一起:从原始文本到词嵌入 155

6.1.4 小结 162

6.2 理解循环神经网络 162

6.2.1 Keras中的循环层 164

6.2.2 理解LSTM层和GRU层 168

6.2.3 Keras中一个LSTM的具体例子 170

6.2.4 小结 172

6.3 循环神经网络的高级用法 172

6.3.1 温度预测问题 172

6.3.2 准备数据 175

6.3.3 一种基于常识的、非机器学习的基准方法 177

6.3.4 一种基本的机器学习方法 178

6.3.5 第一个循环网络基准 180

6.3.6 使用循环dropout来降低过拟合 181

6.3.7 循环层堆叠 182

6.3.8 使用双向RNN 184

6.3.9 更多尝试 187

6.3.10 小结 187

6.4 用卷积神经网络处理序列 188

6.4.1 理解序列数据的一维卷积 188

6.4.2 序列数据的一维池化 189

6.4.3 实现一维卷积神经网络 189

6.4.4 结合CNN和RNN来处理长序列 191

6.4.5 小结 195

本章总结 195

第7章 高级的深度学习最佳实践 196

7.1 不用Sequential模型的解决方案:Keras 函数式API 196

7.1.1 函数式API简介 199

7.1.2 多输入模型 200

7.1.3 多输出模型 202

7.1.4 层组成的有向无环图 204

7.1.5 共享层权重 208

7.1.6 将模型作为层 208

7.1.7 小结 209

7.2 使用Keras回调函数和TensorBoard来检查并监控深度学习模型 210

7.2.1 训练过程中将回调函数作用于模型 210

7.2.2 TensorBoard简介:TensorFlow的可视化框架 212

7.2.3 小结 219

7.3 让模型性能发挥到极致 219

7.3.1 高级架构模式 219

7.3.2 超参数优化 222

7.3.3 模型集成 223

7.3.4 小结 224

本章总结 225

第8章 生成式深度学习 226

8.1 使用LSTM生成文本 227

8.1.1 生成式循环网络简史 227

8.1.2 如何生成序列数据 228

8.1.3 采样策略的重要性 229

8.1.4 实现字符级的LSTM文本生成 230

8.1.5 小结 234

8.2 DeepDream 235

8.2.1 用Keras实现DeepDream 236

8.2.2 小结 241

8.3 神经风格迁移 241

8.3.1 内容损失 242

8.3.2 风格损失 243

8.3.3 用Keras实现神经风格迁移 243

8.3.4 小结 249

8.4 用变分自编码器生成图像 249

8.4.1 从图像的潜在空间中采样 249

8.4.2 图像编辑的概念向量 250

8.4.3 变分自编码器 251

8.4.4 小结 256

8.5 生成式对抗网络简介 257

8.5.1 GAN 的简要实现流程 258

8.5.2 大量技巧 259

8.5.3 生成器 260

8.5.4 判别器 261

8.5.5 对抗网络 261

8.5.6 如何训练DCGAN 262

8.5.7 小结 264

本章总结 264

第9章 总结 265

9.1 重点内容回顾 265

9.1.1 人工智能的各种方法 265

9.1.2 深度学习在机器学习领域中的特殊之处 266

9.1.3 如何看待深度学习 266

9.1.4 关键的推动技术 267

9.1.5 机器学习的通用工作流程 268

9.1.6 关键网络架构 268

9.1.7 可能性空间 272

9.2 深度学习的局限性 273

9.2.1 将机器学习模型拟人化的风险 273

9.2.2 局部泛化与极端泛化 275

9.2.3 小结 276

9.3 深度学习的未来 277

9.3.1 模型即程序 277

9.3.2 超越反向传播和可微层 278

9.3.3 自动化机器学习 279

9.3.4 终身学习与模块化子程序复用 279

9.3.5 长期愿景 281

9.4 了解一个快速发展领域的最新进展 281

9.4.1 使用Kaggle练习解决现实世界的问题 281

9.4.2 在arXiv阅读最新进展 282

9.4.3 探索Keras生态系统 282

9.5 结束语 282

附录A 在Ubuntu上安装Keras及其依赖 283

附录B 在EC2 GPU实例上运行Jupyter笔记本 287

· · · · · · (收起)

读后感

本书自出版以来收到众多好评,因为是 Keras 作者写的书,所以全书基本围绕着 Keras 讲深度学习的各种实现,从 CNN,RNN到GAN等等,总体偏入门,但也承载着很多作者对深度学习整体性的思考。值得一提的是作者推荐用GPU 跑书中的例子,这不是开玩笑, 用CPU 跑你会感到很绝望的~...

评分 评分 评分这本书从6月11号那天老板递到我手里,到今天刚好六周,在这期间我逐字逐句地啃了这本书,并在每周的周二和周五下午给组里的其他人讲这本书,每次讲3个小时。直到五分钟前刚刚讲完最后一章,写了175页的PPT。 感想从何谈起呢?先说Keras吧,这本书的作者是Keras的作者,所以本书...

评分电子版8.4节,从300页开始出现了一个明显的错误,包括代码在内。 原文及代码中 decoder 使用 z = z_mean + exp(z_log_variance) * epsilon 生成 latent space 中的一个点,再依靠这些点的分布生成图像,这实际是对原图像分布的还原过程。 高斯分布可以使用 N~(μ, σ) 来描述,...

用户评价

《Python深度学习》这本书提供了一个非常系统化和深入的学习路径,让我能够从零开始,逐步掌握深度学习的核心知识和技能。从基础的线性代数和微积分在深度学习中的应用,到神经网络的构建和训练,再到各种高级模型的介绍,本书的知识体系构建得非常完善。我特别欣赏书中对于模型评估和调优的讲解。书中详细介绍了各种评估指标,如准确率、精确率、召回率、F1分数等,以及如何通过交叉验证、网格搜索等方法来寻找最优的模型参数。我记得在解决一个图像识别问题时,模型性能迟迟无法提升,后来通过仔细阅读书中关于正则化和学习率调整的章节,并应用了书中提供的建议,模型的性能得到了显著的改善。这本书不仅仅是知识的传授,更是学习方法的引导,它教会我如何系统地思考和解决问题,如何有效地进行实验和迭代。对于想要在深度学习领域打下坚实基础的读者来说,这本书是不可多得的优质资源。

评分《Python深度学习》这本书给了我一种“登高望远”的视野。在阅读之前,我对深度学习的认知是碎片化的,知道一些术语,了解一些模型,但缺乏一个整体的框架。这本书就像一张详细的地图,为我绘制出了深度学习的全貌。它从最基本的神经元开始,层层递进,将各种复杂的模型,如多层感知机(MLP)、卷积神经网络(CNN)、循环神经网络(RNN)等,都清晰地置于一个相互关联的体系之中。书中对于模型训练过程中常见的挑战,例如梯度消失/爆炸、过拟合、欠拟合等,都进行了深入的分析,并提供了行之有效的解决方案。我特别喜欢书中关于正则化技术(如Dropout、L1/L2正则化)的讲解,这些技术在我实际应用中起到了非常关键的作用,帮助我构建出更鲁棒、泛化能力更强的模型。此外,本书对于深度学习在不同领域的应用,如计算机视觉、自然语言处理、甚至强化学习的初步介绍,也让我对深度学习的广阔前景有了更清晰的认识。通过这本书,我不再是那个只知其然不知其所以然的初学者,而是能够更自信地理解和运用深度学习技术去解决实际问题。

评分《Python深度学习》这本书为我提供了坚实的理论基石,让我能够更深入地理解深度学习的底层原理。在许多介绍深度学习的书籍中,对于神经网络的数学原理,如激活函数、损失函数、优化算法等,往往只是点到为止。但这本书不同,它对这些核心概念进行了非常细致的数学推导和解释,让我能够理解为什么这些方法有效,以及它们是如何工作的。例如,在解释反向传播算法时,书中不仅仅提供了代码实现,还详细地讲解了链式法则的应用,以及如何通过数值梯度验证来确保梯度的计算是正确的。这让我对神经网络的训练过程有了更深刻的理解,也为我后续调试和优化模型打下了坚实的基础。此外,书中对于不同类型模型的介绍,例如如何根据不同的任务选择合适的模型架构,以及如何对模型的性能进行评估和分析,都提供了非常有价值的指导。这本书让我从一个“会用”深度学习工具的人,进阶到“理解”深度学习的本质,这对我未来的学习和研究都有着深远的影响。

评分这本书的另一个突出优点是它对当下深度学习研究前沿的及时跟进。虽然深度学习技术发展迅速,但《Python深度学习》这本书在内容上并没有落伍,而是对近年来出现的许多重要模型和技术进行了深入的介绍。例如,书中对注意力机制(Attention Mechanism)和Transformer模型的讲解,让我对现代NLP模型的发展有了更清晰的认识。我特别喜欢书中对Transformer模型内部工作原理的剖析,包括自注意力机制、多头注意力机制以及位置编码等,这些细节的讲解帮助我理解了Transformer为何能在许多NLP任务上取得突破性进展。此外,书中还对生成对抗网络(GAN)的最新进展,以及其在图像生成、风格迁移等方面的应用进行了介绍,这让我对生成模型有了更深的理解。通过阅读和实践书中的内容,我能够紧跟深度学习领域的最新动态,并将这些前沿技术应用到我的实际项目中,这对我提升专业技能非常有帮助。

评分这本书的价值在于它对实践操作的极致关注。许多深度学习的书籍往往会陷入纯理论的海洋,读起来枯燥乏味,但《Python深度学习》却完美地平衡了理论与实践。作者不仅仅是介绍概念,而是通过大量的Python代码示例,将理论知识转化为可执行的操作。从数据预处理、模型构建、训练到评估,每一个环节都有详尽的代码指导。我印象最深刻的是书中关于生成对抗网络(GAN)的章节。GAN的概念本身就比较抽象,但作者通过清晰的图示和易于理解的代码,让我一步步理解了生成器和判别器的博弈过程。通过运行和修改书中的GAN代码,我亲身体验了生成逼真图像的神奇之处。这本书提供的代码库非常完整,并且使用了当下主流的深度学习框架,这对于我快速上手并参与到实际项目中非常有帮助。它让我意识到,学习深度学习不仅仅是理解理论,更重要的是能够将其转化为实际的成果。这本书为我打开了通往实践应用的大门。

评分这本书的作者显然对如何传授深度学习知识有着深刻的理解。他不仅仅是罗列技术细节,而是注重引导读者建立完整的知识体系。从最基础的神经元和感知机,到复杂的深度神经网络,每一个知识点都得到了精心安排,层层递进。我特别欣赏书中关于模型训练的“艺术”的探讨,例如如何选择合适的优化器(SGD, Adam, RMSprop等),如何进行学习率衰减,以及如何利用批量归一化(Batch Normalization)来加速训练和提高模型稳定性。这些实践性的技巧,在实际的项目开发中至关重要。书中提供的代码示例,不仅可以直接运行,还鼓励读者进行修改和实验,从而加深对模型原理的理解。例如,书中在介绍如何构建自定义层时,提供了非常清晰的步骤和示例,这让我能够根据自己的需求扩展模型的功能。总而言之,《Python深度学习》这本书提供了一个全面、深入且极具实践价值的深度学习学习体验,让我受益匪浅,也为我未来的深度学习之路奠定了坚实的基础。

评分这本书让我对深度学习在自然语言处理(NLP)领域的应用有了全新的认识。我一直对文本数据分析和理解充满兴趣,而《Python深度学习》这本书在这方面的内容非常充实。书中对词嵌入(Word Embeddings)的讲解,从One-hot编码到Word2Vec、GloVe,再到更先进的FastText,都做了详细的介绍和对比。我通过书中提供的代码,自己训练了词向量模型,并亲身体验了词向量在捕捉词语语义相似性和类比关系方面的强大能力。更让我兴奋的是,书中对循环神经网络(RNN)在文本序列建模上的应用,以及如何利用LSTM和GRU来处理长文本,进行文本分类、序列标注、机器翻译等任务,都有非常详尽的讲解和示例。我按照书中的指导,构建了一个简单的文本情感分析模型,并在实际数据上进行了训练,取得了令人满意的结果。这本书不仅让我掌握了NLP中的关键技术,更重要的是,它启发了我思考如何将这些技术应用于更复杂的自然语言理解任务,例如问答系统、文本摘要等。

评分这本书简直是我在深度学习领域探索的里程碑。从拿到《Python深度学习》的第一天起,就被它扎实的理论基础和清晰的实践导向深深吸引。作者在解释那些复杂抽象的数学概念时,并没有枯燥的说教,而是巧妙地将它们融入到Python代码的实现中,让我这个对数学公式有些头疼的读者也能逐渐领悟其精髓。比如,书中对于反向传播算法的讲解,从链式法则的数学推导,到如何在TensorFlow/Keras中通过自动微分来实现,都做了非常详尽的阐述。我记得当时花了一个下午的时间,跟着书中的例子一点点调试,看着梯度是如何一层层传递,最终更新模型参数的,那种恍然大悟的感觉至今难忘。而且,作者并没有止步于基础,而是深入探讨了卷积神经网络(CNN)在图像识别领域的应用,从AlexNet到ResNet,再到更先进的模型,每一种模型的设计思路、优缺点都被剖析得淋漓尽致。通过实践书中提供的代码,我不仅能够搭建自己的图像分类器,还能对模型的性能进行优化,甚至尝试迁移学习,在小型数据集上也能取得不错的效果。对于想要系统学习深度学习,并将其应用于实际项目中的开发者来说,这本书无疑是一份宝贵的财富,它提供的不仅仅是知识,更是解决问题的思路和方法。

评分《Python深度学习》这本书的语言风格清晰流畅,极富感染力。作者在讲解复杂的概念时,善于运用生动形象的比喻和贴切的例子,让抽象的知识变得易于理解。我记得书中在解释神经网络中的“权重”和“偏置”时,将其比喻成我们人类大脑中神经元之间连接的强度和阈值,这种类比让我瞬间就理解了它们的作用。即使是对于一些比较难以理解的数学公式,作者也通过详细的推导过程和直观的图示,将它们“翻译”成易于接受的形式。而且,书中在介绍每个模型时,都会先阐述其应用场景和解决的问题,然后再深入讲解其实现细节,这种“由面到点”的学习方式,让我始终能够保持学习的动力和兴趣。这本书不仅仅是一本技术手册,更像是一位耐心的老师,在学习的道路上不断给予我启发和指导,让我能够以更积极的态度去面对深度学习带来的挑战。

评分作为一名一直渴望踏入深度学习领域的开发者,我尝试过很多不同的资源,但《Python深度学习》这本书给我带来的震撼是前所未有的。它不仅仅是一本技术书籍,更像是一位经验丰富的导师,循循善诱地引导我穿越深度学习的复杂迷宫。书中对于循环神经网络(RNN)及其变种,如LSTM和GRU的讲解,尤为精彩。我一直对序列数据处理的挑战感到好奇,而这本书则为我揭示了RNN在处理文本、语音等序列信息时的强大能力。从基础的RNN单元如何捕捉序列依赖,到LSTM如何通过门控机制解决长程依赖问题,再到GRU如何简化结构但保持高性能,每一个细节的讲解都非常到位。书中提供的代码示例,不仅仅是简单的“Hello World”,而是包含了实际的文本生成、情感分析等任务,让我能够亲手构建并体验这些模型的强大之处。更重要的是,作者在讲解过程中,还穿插了许多关于模型选择、超参数调优、以及如何避免过拟合的实用建议,这些都是在学习过程中容易被忽视但至关重要的细节。这本书让我深刻理解了深度学习模型的可解释性以及如何对其进行调试和改进,这对于在实际工作中应用深度学习技术至关重要。

评分不喜欢keras,不评价

评分卷积网络部分一些叙述感觉有点奇怪,但我依然认为是目前相同类型中最出色的一本书。

评分keras教程+机器学习入门。给五星除了内容好,时效性也是这本书的优点。全书使用keras 2.0.8,代码可以完整的在目前的版本上跑。

评分不喜欢keras,不评价

评分深入浅出,通俗易懂

相关图书

本站所有内容均为互联网搜索引擎提供的公开搜索信息,本站不存储任何数据与内容,任何内容与数据均与本站无关,如有需要请联系相关搜索引擎包括但不限于百度,google,bing,sogou 等

© 2026 onlinetoolsland.com All Rights Reserved. 本本书屋 版权所有